TSMCĪó1.6nm┴Ļ┼÷ż╬źūźĒź╗ź╣Č\ĮčA16ż“Įo│½

TSMCżŽ2024Technology Symposiumż“ź½źĻźšź®źļź╦źó䔟Ąź¾ź┐ź»źķźķżŪ│½╠¢Īó2nmż╬╝Īż╬1.6nmż╦┴Ļ┼÷ż╣żļČ\Įčż“╚»╔ĮżĘż┐ĪŻ└ĶĮĄĪó2024ŃQŗī1╗═╚Š┤³(1Q)ż╦ż¬ż▒żļĘQ╝ęż╬»éōQż¼╚»╔ĮżĄżņż┐ĪŻIntelĪóSK hynixĪóźļź═źĄź╣ź©źņź»ź╚źĒź╦ź»ź╣ĪóźĮźĘź¬ź═ź»ź╣ź╚ż╩ż╔ż¼»éōQż“╚»╔ĮĪŻÖ┌└«AIĖ■ż▒ż╬│žØ{źĮźšź╚ż“Ę┌ż»ż╣żļż╚żżż”Ų░żŁżŌżóżĻĪóAIźūźĒź╗ź├źĄż“ĮĖ└čż╣żļSoCżžż╬┤³┬įż¼╦─żķżÓĪŻ

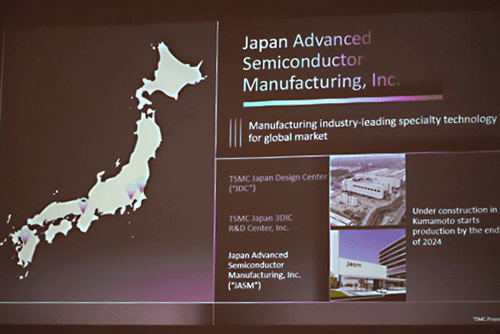

┐▐1ĪĪTSMCż╬Ų³╦▄ż╦ż¬ż▒żļĖĮ║▀ż╬źūźņź╝ź¾ź╣ĪĪ▓Ż┘pĪ”Įj║Õż╬źŪźČźżź¾ź╗ź¾ź┐Ī╝Īóż─ż»żąż╬3D-IC R&Dź╗ź¾ź┐Ī╝Īóķy╦▄ż╬JASMż╦Ą“┼└

TSMCż╬2024 Technology Symposiumż¼╗Žż▐ż├ż┐ĪŻż│ż╬╗Žż▐ż├ż┐ż╚╔ĮĖĮżĘż┐ż╬żŽĪó└ż─cĘQ├ŽżŪż│żņż½żķĮń╝Ī│½╠¢żĘżŲżżż»ż½żķż└ĪŻż│ż”żżż├ż┐źżź┘ź¾ź╚żŽźĒĪ╝ź╔źĘźńĪ╝ż╚Ė└ż’żņżŲżżżļĪŻä▌╣±żŽź¬Ī╝ź╣ź┴ź¾Īóź▄ź╣ź╚ź¾ż╚3ź½ĮĻövż├ż┐ż╬ż┴Īó▓żä”Ī󱜎čĪó├µ╣±Īóźżź╣źķź©źļż╚övżĻĪó║ŪĖÕż╬6ĘŅ28Ų³ż╦Ų³╦▄żŪ│½╠¢ż╣żļ═Į─Ļż╚ż╩ż├żŲżżżļĪŻ║ŻövĪó1.6nmźūźĒź╗ź╣ź╬Ī╝ź╔ż╦┴Ļ┼÷ż╣żļA16źūźĒź╗ź╣Č\Įčż“│½╚»Īó2nmźūźĒź╗ź╣ż╦┴Ļ┼÷ż╣żļN2ż╬╝Īż╚żżż”░╠Åøż┼ż▒żŪĪó2026ŃQż╦╬╠ŠÅ│½╗Žż╣żļż╚żżż”╝Ŗ▓Ķż└ĪŻAżŽź¬ź¾ź░ź╣ź╚źĒĪ╝źÓż½żķ═Ķż┐├▒░╠żŪżóżļĪŻTSMCżŪżŽN3EźūźĒź╗ź╣ż“╬╠ŠÅżĘżŲż¬żĻĪóN2źūźĒź╗ź╣żŽ25ŃQż╬ĖÕ╚Šż╦╬╠ŠÅż╣żļ═Į─Ļż╚ż╩ż├żŲżżżļĪŻ

A16źūźĒź╗ź╣żŽĪóź╩ź╬źĘĪ╝ź╚ż“ŠW├ōż╣żļGAAĪ╩ź▓Ī╝ź╚ź¬Ī╝źļźóźķź”ź¾ź╔Ī╦ź╚źķź¾źĖź╣ź┐Č\Įčż╚Īó╬óĀC┼┼Ė╗Ū█└■Č\ĮčżŪżóżļSuper Power RailČ\Įčż“╗╚ż”╝Ī└ż┬ÕČ\ĮčżŪżóżļĪŻN2PźūźĒź╗ź╣żŪż╬Ų▒żĖź╔źņźżź¾┼┼░ĄŠ“°Pż╚╚µż┘żŲ└Łē”Ī╩Ų░║ŅÅ]┼┘)ż¼8~10%▓■║¤żĘĪóŲ▒▐kÅ]┼┘ż╩żķ15~20%Š├õJ┼┼╬üż¼žōŠ»ż╣żļż╚żĘżŲżżżļĪŻĮĖ└č┼┘żŌ10%Ė■æųż╣żļĪŻ

TSMCżŽźŌź╬źĻźĘź├ź»ż╩ĮĖ└č┼┘Ė■æųż└ż▒żŪżŽż╩ż»Īó└Ķ├╝źčź├ź▒Ī╝źĖż“ŠW├ōż╣żļĮĖ└č┼┘Ė■æųżŌ┐╩żßżŲż¬żĻĪóInFOĪ╩Integrated Fan-OutĪ╦żõCoWoSĪ╩Chip on Wafer on SubstrateĪ╦ż╦¶öżŁĪóSystem on WaferĪ╩SoWĪ╦Č\Įčż╦ż─żżżŲżŌ│½╚»├µżŪżóżļż│ż╚ż“Įęż┘żŲżżżļĪŻCoWoSČ\ĮčżŪżŽAIź┴ź├źūż╩ż╔ż╬źūźĒź╗ź├źĄż╚HBMĪ╩High Bandwidth MemoryĪ╦ż“┤łæųż╦╩┬ż┘żŲŪ█Åøż╣żļ2.5DČ\ĮčżŪżóżļż¼Īó3Dź╣ź┐ź├ź»ż“ŠW├ōż╣żļSoICĪ╩System on Integrated ChipsĪ╦Č\ĮčżŌ│╬╬®żĘż┐ż╚żżż”ĪŻSoICż╚┬Šż╬ŗēäżŌŲ▒▐k┤łæųż╦┼ļ║▄ż╣żļē|Č╦ż╬SiPĪ╩System in PackageĪ╦Č\Įčż“źµĪ╝źČĪ╝żŽ╗╚ż©żļż│ż╚ż¼żŪżŁżļż╚żĘżŲżżżļĪŻź”ź¦Ī╝źŽæųż╦SoICżõHBMż╩ż╔ż“ĮĖ└čż╣żļSoWČ\Į迎Īóź│ź¾źįźÕĪ╝źŲźŻź¾ź░ē”╬üż“ż│żņż▐żŪ░╩æųż╦æųż▓żļČ\ĮčżŪżóżĻĪóØŖż╦źŪĪ╝ź┐ź╗ź¾ź┐Ī╝ŲŌż╬ź│ź¾źįźÕĪ╝ź┐źķź├ź»ż╦╔żØŌż╣żļź│ź¾źįźÕĪ╝źŲźŻź¾ź░ē”╬üż“Ęeż─ż╚Ė½żŲżżżļĪŻ┴└żżżŽżŌż┴żĒż¾╣ŌĮĖ└čż╬AIź│ź¾źįźÕĪ╝ź┐ż└ĪŻ

Intelż¼2024ŃQ1Qż╬Ūõæų±Yż¼ØiŃQŲ▒┤³╚µ9%╗\ż╬127▓»ź╔źļż╦ż╩ż├ż┐ż╚╚»╔ĮżĘż┐ĪŻNon-GAAPĪ╩ØÖ▓±╝ŖĖČō¦Ī╦żŪż╬Ūõæų±Yż╦×┤ż╣żļ»¤ŠW▒ū╬©żŽ45.1%Īó▒─Č╚ŠW▒ū╬©żŽ5.7%ż╚▌üÖCżŪĪóĮŃŠW▒ūżŌ8▓»ź╔źļż╬▌üÖCż╚ż╩ż├ż┐ĪŻØiŃQŲ▒┤³żŽśĘÖCĪŻCPUżõSoCż╩ż╔ż╬×æēäź░źļĪ╝źūż╬Ūõæų±YżŽØiŃQŲ▒┤³╚µ17%╗\ż╬119▓»ź╔źļż└ż¼ĪóIntel Foundryż╬żĮżņżŽŲ▒10%žōż╬44▓»ź╔źļĪóAlterażõMobileyeż╩ż╔ż╬żĮż╬┬Šŗ╠ń7.75▓»ź╔źļĪóĘQź╗ź░źßź¾ź╚┤ųż╬─_╩Żż“Į³żŁĪó╣ń╝Ŗż╬Ūõæų±Yż¼127▓»ź╔źļż╚ż╩ż├żŲżżżļĪŻ

×æēäź░źļĪ╝źūżŽ33▓»ź╔źļż╬▒─Č╚▌üÖCż└ż¼ĪóźšźĪź”ź¾ź╔źĻŗ╠ńżŽ25▓»ź╔źļż╬▒─Č╚śĘÖCż╚ż╩ż├żŲżżżļĪŻEUVż╬Ų│Ų■ż╦żĶżĻ▌xŠņż▐żŪż╬ź”ź¦Ī╝źŽĮĶ═²┤³┤ųż¼ø]Į╠żĘżŲź╣źįĪ╝ź╔ż¼3Ū▄ż╦æųż¼żļż┐żßĪó║ŻĖÕASPĪ╩╩┐Čč├▒▓┴Ī╦żŽæųż¼żļż╚┤³┬įżĘżŲżżżļĪŻIntel 18AźūźĒź╗ź╣ż╬6╚ųų`ż╬Ė▄Ąęż╦×┤żĘżŲPDK 1.0Ī╩źūźĒź╗ź╣│½╚»źŁź├ź╚1.0Ī╦ż“2Qż╦─¾ČĪżĘ25ŃQØi╚Šż╦╬╠ŠÅ│½╗Žż╣żļ╝Ŗ▓Ķż╚ż╩ż├żŲżżżļĪŻ

SK Hynixż╬1QżŪż╬Ūõæų±YżŽØiŃQŲ▒┤³╚µ144%╗\żŪØi┤³╚µżŪżŌ10%╗\ż╬12.43├¹ź”ź®ź¾Ī╩1ź”ź®ź¾=0.11▀ģĪ╦ż╚ż╩żĻ▒─Č╚ŠW▒ūżŌ2.89├¹ź”ź®ź¾ĪóĮŃŠW▒ū1.92├¹ź”ź®ź¾ż╚ż╩żĻśĘÖCż½żķ├”ĮążĘż┐ĪŻźļź═źĄź╣ż╬1QŪõæų±YżŽØiŃQŲ▒┤³╚µ2.2%žōż╚ż╩ż├ż┐ż¼3518▓»▀ģż╚żĘĪó▒─Č╚ŠW▒ū╬©żŽ32.3%ż“│╬╩▌żĘż┐ĪŻØiŃQŲ▒┤³ż╚╚µż┘ĪóŲ³╦▄ż╚├µ╣±ż╬Ūõæųż¼żĮżņżŠżņ170▓»▀ģĪó50▓»▀ģż╬ź▐źżź╩ź╣Īó▓żä”żŌ20▓»▀ģż╬ź▐źżź╩ź╣ż└ż¼ĪóĒ×ä▌ż╚źóźĖźóż¼źūźķź╣ż└ż├ż┐ż┐żß┴Ļ£¹żĘżŲ2.2%ż╬ź▐źżź╩ź╣ż╚ż╩ż├ż┐ĪŻźĮźĘź¬ź═ź»ź╣ź╚ż╬1QĪ╩2023ŃQ┼┘4Qż╚ż╩żļ24ŃQ1Ī┴3ĘŅ┤³Ī╦Ūõæų±YżŽØiŃQŲ▒┤³╚µ4.3%žōż╬516▓»▀ģĪó▒─Č╚ŠW▒ū╬©14.7%żŪĪóĮŃŠW▒ūżŽ58▓»▀ģż╬▌üÖCż╚ż╩ż├ż┐ĪŻ2023ŃQ┼┘µ£öüż╬Ūõæų±YżŽØiŃQ┼┘╚µ14.8%╗\ż╬2212▓»▀ģż╚ż╩żĻĪó▒─Č╚ŠW▒ū╬©żŌ16.1%ż“│╬╩▌żĘż┐ĪŻ

Ö┌└«AIżŽ├ō²ŗ╩╠ż╦▒■żĖż┐×æēäż¼╚»╔ĮżĄżņż┐ĪŻMicrosoftżŽOpenAIż╦Įą½@żĘżŲżżżļż¼Īó╚Óżķż╬GPTźĘźĻĪ╝ź║ż╚żŽ╩╠ż╦żŌż├ż╚Ę┌żżĪųPhi-3Īūż“│½╚»żĘż┐ĪŻź╣ź▐Ī╝ź╚źšź®ź¾ż╬SoCźūźĒź╗ź├źĄż╦ĮĖ└čżĘż┐AI└ņ├ōźūźĒź╗ź├źĄŲŌżŪŲ░ż½ż╗żļżĶż”ż╦Īó│žØ{źčźķźßĪ╝ź┐┐¶żŽ38▓»Īó70▓»Īó140▓»ż╬3¹|╬Óż“├ō┴TżĘż┐ĪŻź┴źŃź├ź╚GPTż╬GPT-3żŽ1750▓»źčźķźßĪ╝ź┐ż╚ĄĮjĪŻż▐ż┐ĪóMetażŽ┐ʿʿżĮjæä╠ŽĖ└ĖņźŌźŪźļĪųLlama3Īūż“╚»╔ĮżĘĪó80▓»ż╚800▓»źčźķźßĪ╝ź┐ż╬2ż─ż╬źŌźŪźļż“─¾ČĪż╣żļĪŻ