NvidiaĪó1├¹źčźķźßĪ╝ź┐ż╬Ö┌└«AIĖ■ż▒┐ĘGPUż╚AIź│ź¾źįźÕĪ╝ź┐ż“╚»╔Į

╚ŠŲ│öüĮķż╬╗■▓┴┴Ē±Y1├¹ź╔źļ┤ļČ╚ż╚ż╩ż├ż┐Nvidiaż╬▐kĮjźżź┘ź¾ź╚żŪżóżļGTC 2024ż¼║ŻĮĄĮķżßż╦ä▌ź½źĻźšź®źļź╦źó䔟Ąź¾ź╬ź╝żŪ│½╠¢żĄżņĪó1├¹źčźķźßĪ╝ź┐ż“ĮĶ═²ż╣żļż┐żßż╬┐ʿʿżAIź┴ź├źūĪųGB200Īūż“£½żķż½ż╦żĘż┐ĪŻż│ż╬×æē俎Īó┐ĘGPUĪųBlackwellĪūż“2Ė─ż╚CPUĪųGraceĪū1Ė─ż“ĮĖ└čżĘż┐SiPĪ╩System in PackageĪ╦ĪŻBlackwellżŌĪó2ź┴ź├źū╣Į└«ż╚ż╩ż├żŲż¬żĻĪóGPU1Ė─żŪżŌĄĮjż╩ź┴ź├źūż╚ż╩ż├żŲżżżļĪŻż╩ż╝ĄĮjż╩ź┴ź├źūż¼ØŁ═ūż½ĪŻ

┐▐1ĪĪNvidiaż╬┴ŽČ╚ŪvĘ¾CEOż╬Jensen HuangĢ■ĪĪĮąųZĪ¦Nvidiaż╬╣ų▒ķź╣źķźżź╔

GTCżŽż½ż─żŲGPU Technology Conferenceż╚Ō}żążņżŲżżż┐ż¼Īó┤─┤╣ų▒ķż╦╬®ż├ż┐Nvidia╝ęż╬┴ŽČ╚ŪvĘ¾CEOżŪżóżļJensen HuangĢ■Ī╩┐▐1Ī╦żŽĪóGPUĪ╩ź░źķźšźŻź├ź»źūźĒź╗ź├źĄźµź╦ź├ź╚Ī╦ż╚żżż”ć@Š╬żŽżŌżŽżõāįĄŅż╬żŌż╬ż╦ż╩żĻż─ż─żóżļĪóż╚Įęż┘ż┐ĪŻGPUżŽĪóżŌż╚żŌż╚CGĪ╩ź│ź¾źįźÕĪ╝ź┐ź░źķźšźŻź├ź»ź╣Ī╦żŪ│©ż“ķWż»ż┐żßż╬ź┴ź├źūżŪżóż├ż┐ż¼Īóź╦źÕĪ╝źķźļź═ź├ź╚ź’Ī╝ź»źŌźŪźļż¼╝┬├ō▓ĮżĄżņżŲ░╩═ĶĪó├▒ż╩żļŠ«żĄż╩└čŽ┬▒ķōQ▀_ż“Įj╬╠ż╦Ęeż─AIź┴ź├źūż╚żĘżŲżŌ╗╚ż©ż┐ĪŻGPUżŪżŽĪóźŪź├źĄź¾ż╦ż╗żĶĪó┐¦┼╔żĻż╦ż╗żĶĪó1ĮŚż╬│©ż“ĪóŠ«żĄż╩źųźĒź├ź»ż╦╩¼│õżĘżŲĪóĘQźųźĒź├ź»ż“Ų▒╗■ż╦╩┬š`Ų░║ŅżĄż╗żŲķW▓Ķż╣żļż¼ĪóżĮż╬ĘQźųźĒź├ź»ż╬▒ķōQż¼ż▐żĄż╦└čŽ┬▒ķōQżŪżóż├ż┐ĪŻź╦źÕĪ╝źķźļź═ź├ź╚ź’Ī╝ź»ż╬źŌźŪźļż╚µ£ż»Ų▒══ż╩└■Ę┴┬Õ┐¶ż╬╣įš`▒ķōQŲ░║ŅżŪżóż├ż┐ż½żķĪóGPUż¼AIź┴ź├źūż╚żĘżŲżĮż╬ż▐ż▐╗╚ż’żņżŲżŁż┐ĪŻ

AIżŽÖ┌└«AIż╦╚»·tżĘĪó│žØ{żĄż╗żļż┘żŁźčźķźßĪ╝ź┐┐¶żŽĪóź┴źŃź├ź╚GTPż╬ź┘Ī╝ź╣ż╚ż╩żļGPT-3żŪ1750▓»źčźķźßĪ╝ź┐ż╦żŌż╩żĻĪóĄĮjż╩│žØ{źĮźšź╚ź”ź©źóż╚ż╩ż├ż┐ĪŻGPT-3.5żõGPT-4ż╬żĶż”ż╦Ī󿥿ķż╩żļźčźķźßĪ╝ź┐┐¶ż╬╗\▓├żŽĪóż│żņż▐żŪż╬GPUżŪżŽż╚żŲżŌ┤ųż╦╣ńż’ż╩żżĪŻGPT-3ż╬│žØ{ż╦żŽA100ż╬GPUżŪ300Ų³ż½ż½ż├ż┐ż╚Ė└ż’żņżŲżżżļĪŻżĄżķż╦ĮjżŁż╩GPT-4żŽ1├¹źčźķźßĪ╝ź┐ż╦ż╩żļż╚żżż”ĪŻż│żņżŪżŽ│žØ{ż╦▓┐ŃQżŌż½ż½ż├żŲżĘż▐ż”ĪŻGPUż╬└Łē”ż¼żŌż├ż╚╣Ōż»ż╩ż▒żņżąĮĶ═²żŪżŁż╩żżĪŻNvidiaż¼║“ŃQ║Ū╣Ō└Łē”ż╬AIź┴ź├źūĪųGrace HopperĪūż“ĮążĘż┐ż¼Īó║ŻŃQż╬GTC 2024żŪżŽĪ󿥿ķż╦╣Ō└Łē”ż╩ź┴ź├źūż¼┼ąŠņżĘż┐ĪŻ

╣Ō└Łē”ż╩AIź┴ź├źūżŪżŽĪóź╦źÕĪ╝źķźļź═ź├ź╚ź’Ī╝ź»źŌźŪźļż╦┼¼żĘż┐╝ŖōQŠ}╦Īż¼ĄßżßżķżņżŲżżżļĪŻGPUż└ż▒ż└ż╚╠ĄŠGż╩╝ŖōQż¼¾Hż»ĪóŠ├õJ┼┼╬üż¼ĮjżŁż╣ż«ż┐ĪŻØŖż╦Īóź╦źÕĪ╝źķźļź═ź├ź╚ź’Ī╝ź»ż╬└čŽ┬▒ķōQżŪżŽaĪ▀0ż╚żżż”╝ŖōQż¼Č╦żßżŲ¾HżżĪŻ┼·ż©żŽ0Ī╩ź╝źĒĪ╦ż╦»éż▐ż├żŲżżżļż╬ż╦żŌż½ż½ż’żķż║GPUżŪżŽµ£żŲż╬▒ķōQż“ĪųĖ[╝»┘ć─Šż╦Īū╣įż├żŲżŁż┐ĪŻżĮż│żŪĪóNvidiażŽĪó║“ŃQ╚»╔ĮżĘż┐H200Ī╩ź│Ī╝ź╔ć@Grace HopperĪ╦ż╚żżż”AIź┴ź├źūżŪżŽĪóaĪ▀0ż╚żżż”╝ŖōQż¼¾HżżšÅ╣įš`żŽCPUĪ╩GraceĪ╦żŪ0ż╚żżż”»éż▐ż├ż┐┐¶ÖCż╦╩č┤╣żĘĪó0żŪżŽż╩żż╝ŖōQż╬╠®╣įš`ż“GPUżŪ╣įż”öĄ╝░ż“ż╚ż├ż┐ĪŻ

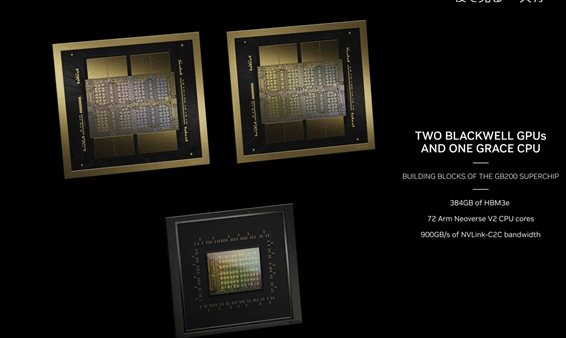

║Żövż╬AIź┴ź├źūĪųGB200Īū(┐▐2)ż╦2Ė─ż╬GPUĪųBlackwellĪūż╚CPUż“┼ļ║▄żĘż┐ż╬żŽĪóšÅ╣įš`ż╚╠®╣įš`ż“żĮżņżŠżņż¼├┤┼÷ż╣żļż┐żßż└ż╚╗ūż’żņżļĪŻGB200ż╬┐õébż╦ż¬ż▒żļAI└Łē”żŽĪóż│żņż▐żŪ║Ū╣Ōż└ż├ż┐H100 ż╬30Ū▄ż╦żŌæųżļĪŻ

┐▐2ĪĪ┐ʿʿżGPUż╬ĪųBlackwellĪūź┴ź├źūż“2Ė─ż╚ĪóNeoverse V2 CPUź│źóź┘Ī╝ź╣ż╬CPUź┴ź├źū1Ė─żŪ╣Į└«żĄżņżļGB200ĪĪĮąųZĪ¦Nvidiaż╬╣ų▒ķź╣źķźżź╔

ż│ż╬┐ĘĘ┐GPUż╬ĪųBlackwellĪūĪ╩┐▐2ż╬æųż╬2Ė─ż╬ź┴ź├źūĪ╦ż╦ĮĖ└迥żņż┐ź╚źķź¾źĖź╣ź┐┐¶żŽĪóż│żņż▐żŪ║ŪĮjż╬2080▓»Ė─ż╦żŌæųżļĪŻżĘż½żŌĘQBlackwellżŽĪ󿥿ķż╦Ų¾ż─ż╬ź└źżż╦╩¼ż½żņżŲż¬żĻĪó2Ė─ż╬ź└źżż“▐kż─ż╬GPU×æēäż╚╣Į└«żĘżŲżżżļĪŻżĮżņżŠżņż╬ź└źżżŽHBM3EźßźŌźĻż“4Ė─ż║ż─Ęeż┴Īó╣ń╝Ŗ8Ė─żŪ384GBż╬źßźŌźĻż“Ęeż├żŲżżżļĪŻCPUżŽArmż╬64źėź├ź╚ż╬źŪĪ╝ź┐ź╗ź¾ź┐Ī╝Ė■ż▒ż╬Neoverse V2ź│źóż“72Ė─ĮĖ└čżĘż┐żŌż╬ĪŻ║ŪŖZArmżŽżĄżķż╦╣Ō└Łē”ż╩Neoverse V3ż“╚»╔ĮżĘżŲżżżļĪ╩╗▓╣═½@╬┴1Ī╦ĪŻ

AIź╣Ī╝źčĪ╝ź│ź¾źįźÕĪ╝ź┐żŌ─¾░Ų

NvidiażŽ1├¹źčźķźßĪ╝ź┐ż“ĮĶ═²ż╣żļż┐żßż╬AIź│ź¾źįźÕĪ╝ź┐żŌ─¾░ŲżĘż┐ĪŻĪųGrace Blackwell ź╣Ī╝źčĪ╝ź┴ź├źūĪūż╚Ō}żųGB200ż“2Ė─Īó▐kż─ż╬ź│ź¾źįźÕĪ╝ź┐ź▄Ī╝ź╔Ī╩ź│ź¾źįźÕĪ╝ź╚ź╚źņźżż╚Ō}żųĪ╦ż╦╝²żßĪóż│ż╬ź▄Ī╝ź╔ż“18ĮŚź│ź¾źįźÕĪ╝ź┐źķź├ź»ż╦╝┬äóżĘż┐ĪŻż─ż▐żĻĪó1±śż╬ź│ź¾źįźÕĪ╝ź┐źķź├ź»ż╦72Ė─ż╬Blackwell GPUż¼┼ļ║▄żĄżņżŲżżżļĪŻżĮżņż“NVLinkż╚żżż”╣ŌÅ]źżź¾ź┐Ī╝źšź¦źżź╣żŪµ£żŲż╬GPUż“└▄¶öż╣żļĪŻż│ż╬Šņ╣ńż╬źßźŌźĻżŽµ£żŲż╬GPUż¼źŪĪ╝ź┐ż“Č”Ń~ż╣żļź│źęĪ╝źņź¾ź╚ėX▌åż╦żĘżŲżżżļĪŻż╣ż┘żŲż╬GPUż“ż─ż╩ż░NVLinkżŪż╬ź┴ź├źū┤ųż╬źŪĪ╝ź┐źņĪ╝ź╚żŽ900GB/sż╚Č╦żßżŲ╣ŌÅ]ż└ĪŻź│ź¾źįźÕĪ╝ź╚ź╚źņźżż╬AI└Łē”żŽ80PetaFLOPSż╚╣Ōż»ĪóźßźŌźĻ═Ų╬╠żŽ1.7TBĪŻ

ż│ż╬ź│ź¾źįźÕĪ╝ź┐ĪųGB200 NVL72ĪūżŽźķź├ź»ź╣ź▒Ī╝źļż╦ż╩ż├żŲż¬żĻĪó80Peta FLOPSż╬ź│ź¾źįźÕĪ╝ź╚ź╚źņźżż¼18ĮŚżŪ╣Į└«żĄżņżŲżżżļż┐żßĪó1.4Exa FLOPSż╚żżż”ź╣Ī╝źčĪ╝ź│ź¾źįźÕĪ╝ź┐ż╦ż╩żļĪŻż│ż╬└Łē”żŽĪóŲ³╦▄ż╬ź╣źčź│ź¾Īų╔┘▀tĪūż╬ż¬żĶżĮ3Ū▄ż╬└Łē”żŪżóżĻĪóĖĮ║▀TOP500żŪŠę▓żĄżņżŲżżżļ║Ū╣Ō└Łē”ż╬ź╣źčź│ź¾ĪųFrontierĪūż╬1.2Exa FLOPS ż“«Ćż©żļż│ż╚ż╦ż╩żļĪŻ1├¹źčźķźßĪ╝ź┐ż╬Ö┌└«AIż╦żŽż│ż╬µć┼┘ż╬└Łē”ż¼Ąßżßżķżņżļż╚żĘżŲżżżļĪŻżĄżķż╦ż│ż╬ź│ź¾źįźÕĪ╝ź┐źķź├ź»ż“Įj╬╠ż╦╩┬ż┘żļż╚Īó┐Ę╗■┬Õż╬ź╣Ī╝źčĪ╝ź│ź¾źįźÕĪ╝ź┐ż╬źŪĪ╝ź┐ź╗ź¾ź┐Ī╝ż¼Įą═Ķæųż¼żļż╚Ė½└čżŌż├żŲżżżļĪŻż│ż╬źŪĪ╝ź┐ź╗ź¾ź┐Ī╝ż╬AI└Łē”żŽ645 Exa FLOPSż╚ż╚żŲż─żŌż╩ż»ĄĮjż╦ż╩żļĪŻ

GPUżõCPUż“Įj╬╠ż╦╩┬š`Ų░║ŅżĄż╗żļŠņ╣ńż╦żŽĪóżŌżŽżõźąź╣öĄ╝░żŽ╗╚ż©ż╩żżż┐żßĪóź╣źżź├ź┴öĄ╝░żŪźŪĪ╝ź┐ż╬╬«żņż“┼D═²ż╣żļØŁ═ūż¼żóżļĪŻżĮż│żŪĪóź╣źżź├ź┴├ōż╬NVLink├ōż╬ICżŌ│½╚»żĘżŲżżżļĪŻNVLinkżŽ║ŪĮj576Ė─ż╬GPUż“└▄¶öżŪżŁĪó┴Ē╣ń┼¬ż╩źąź¾ź╔╔²żŽ1Peta B/sżŪĪó╣ŌÅ]źßźŌźĻ═Ų╬╠żŽ240TBż╚ĮjżŁżżĪŻ

╗▓╣═½@╬┴

1. ĪųArmĪ󟻟ļź▐ż╬źŪĪ╝ź┐ź╗ź¾ź┐Ī╝▓Įż╦Ė■ż▒IPź│źóż“Į╝╝┬ĪūĪóź╗ź▀ź│ź¾ź▌Ī╝ź┐źļ (2024/03/19)